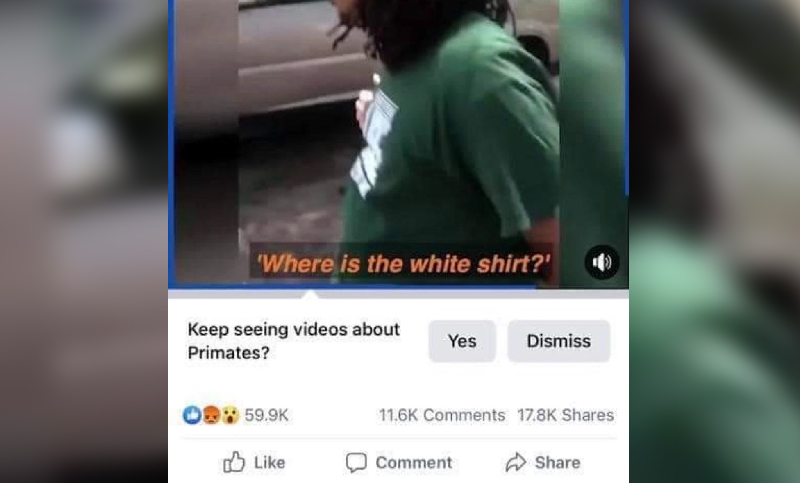

«¿Desea seguir viendo videos sobre primates?». Esta es la frase que aparecía en Facebook luego de que varias personas vieran videos donde aparecían personas de tez morena, según lo informó en una nota el New York Times.

Tras este grave suceso, la compañía pidió disculpas por el “error inaceptable” en un comunicado que fue enviado al Daily Mail, quien publicó el video en cuestión, y deshabilitó la función de recomendación responsable del mensaje, además de prometer encontrar la causa del error para evitar que vuelvan a ocurrir este tipo de sucesos.

Dani Lever, portavoz de la compañía, dijo en un comunicado:

“Como hemos dicho, aunque hemos realizado mejoras en nuestra IA, sabemos que no es perfecta y tenemos más avances que hacer. Pedimos disculpas a todos los que hayan visto estas recomendaciones ofensivas”.

El sesgo de género y racial es un problema frecuente en la inteligencia artificial en general, y ya vimos problemas similares en otras plataformas además de Facebook. Por ejemplo, las coincidencias de reconocimiento facial falsas llevaron al injusto arresto de dos hombres negros el año pasado en Detroit. En 2015, Google Photos etiquetó las fotos de personas afroamericanas como “gorilas”.

Te puede interesar: Multan a Facebook por U$S267 millones por no tener políticas claras de intercambio de datos

Hace unos meses, Facebook compartió un conjunto de datos que creó con la comunidad de inteligencia artificial. Este trabajo contenía más de 40.000 videos de 3.000 actores pagos que la red social usó para enseñar a los sistemas de IA cómo lucen los diferentes tonos de piel de las personas en diferentes condiciones de iluminación. Claramente no fue suficiente para resolver por completo el sesgo de IA para Facebook, ya que sigue teniendo graves problemas de reconocimiento.